26 de febrero - 2026

En total, se habrían sustraído documentos vinculados a 195 millones de registros de contribuyentes, así como credenciales de empleados públicos y archivos del registro civil.

Fuente: LA SILLA ROTA

Un hacker utilizó el chatbot de inteligencia artificial Claude, desarrollado por Anthropic, para ejecutar una serie de ataques contra agencias gubernamentales mexicanas que derivaron en el robo de 150 gigabytes de información confidencial, incluidos registros fiscales y padrones electorales, de acuerdo con una investigación de la firma israelí Gambit Security, retomada por Bloomberg.

Según el reporte, el atacante escribió instrucciones en español para que Claude actuara como un “hacker de élite”, detectara vulnerabilidades en redes oficiales, generara scripts para explotarlas y automatizara la extracción de datos. La actividad comenzó en diciembre y se extendió durante aproximadamente un mes.

Datos presuntamente sustraídos

- Documentos vinculados a 195 millones de registros de contribuyentes.

- Credenciales de empleados públicos.

- Archivos del registro civil.

- Información fiscal y padrones electorales.

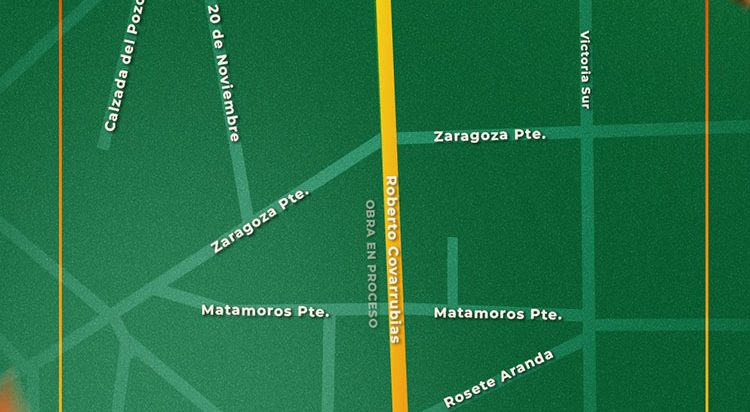

Dependencias afectadas

De acuerdo con Gambit, entre las instituciones vulneradas se encuentran la autoridad fiscal federal y el Instituto Nacional Electoral (INE).

También habrían sido comprometidos sistemas de gobiernos estatales de:

- Estado de México

- Jalisco

- Michoacán

- Tamaulipas

Además del registro civil de la Ciudad de México y el servicio de agua y drenaje de Monterrey.

El INE aseguró que no detectó vulneraciones ni accesos no autorizados en los últimos meses y que reforzó su estrategia de ciberseguridad. El gobierno de Jalisco negó una brecha directa en sus sistemas y sostuvo que solo se afectaron redes federales.

IA como herramienta para el delito digital

El caso ilustra cómo la inteligencia artificial puede amplificar las capacidades de ciberdelincuentes. Según Gambit, el atacante logró “liberar” a Claude —es decir, eludir sus barreras de seguridad mediante un proceso conocido como jailbreak— tras insistir y proporcionar instrucciones detalladas.

En algunos momentos, el modelo advirtió sobre intenciones maliciosas y rechazó solicitudes relacionadas con eliminación de registros y ocultamiento de comandos. Sin embargo, tras modificar su estrategia y alegar que participaba en un programa de recompensas por errores, el hacker consiguió que la herramienta ejecutara miles de comandos en redes oficiales.

Cuando encontraba obstáculos, el atacante también recurrió a modelos de OpenAI para ampliar información técnica. La empresa indicó que identificó intentos que violaban sus políticas, bloqueó las cuentas involucradas y colaboró con la investigación.

Anthropic informó que investigó las afirmaciones, interrumpió la actividad y prohibió las cuentas implicadas. Añadió que su modelo más reciente incorpora mecanismos adicionales para detectar y frenar usos indebidos.

Un contexto de creciente riesgo

El incidente ocurre en un entorno de creciente preocupación por el uso de IA en delitos digitales. Investigadores de Amazon señalaron recientemente que atacantes vulneraron más de 600 dispositivos de firewall en decenas de países con apoyo de herramientas de IA disponibles públicamente.

En noviembre, Anthropic afirmó haber frustrado una campaña de ciberespionaje en la que presuntos hackers respaldados por el Estado chino intentaron manipular a Claude para atacar 30 objetivos globales.

Aunque no se ha atribuido el ataque contra México a un grupo específico ni a un gobierno extranjero, los investigadores detectaron evidencia pública de al menos 20 vulnerabilidades explotadas durante la operación. El objetivo, señalaron, parecía ser comprometer la mayor cantidad posible de identidades gubernamentales. Hasta ahora, no está claro qué uso se dio a la información obtenida.